Quando si lavora con i dati, la sensazione è quella di essere circondati da un mondo “oggettivo”. I numeri sembrano parlare da soli, i grafici appaiono chiari, le metriche danno sicurezza. Eppure è proprio questa apparente solidità a rendere l’analisi dei dati un terreno scivoloso. Molte “insidie” non nascono da distrazioni evidenti o da calcoli sbagliati, ma da errori più difficili da individuare.

Non è raro, infatti, imbattersi in database viziati oppure partire da ragionamenti logici completamente scorretti. Analizziamo allora quali sono gli sbagli nell’analisi dati più frequenti.

Perché è facile commettere sbagli nella data analysis

Sbagliare nell’analisi dei dati è più semplice di quanto sembri. Questo perché ogni analisi parte da ipotesi, aspettative e modelli mentali che influenzano il modo in cui selezioni i dati, li osservi e li interpreti. Anche con strumenti avanzati e dataset accurati, la complessità cresce più velocemente della capacità umana di controllarla, e ciò apre la porta a errori sistemici che non dipendono dall’esperienza o dal ruolo, ma dal modo in cui ragioni davanti ai numeri.

Gli errori più comuni nell’analisi dei dati

Quando parliamo di errori nella data analysis, la maggior parte dei problemi nasce da schemi ricorrenti che si ripetono in contesti diversi, indipendentemente dal settore o dal volume dei dati. Ecco perché è fondamentale conoscere queste aree critiche.

Errori di interpretazione e assunzioni sbagliate

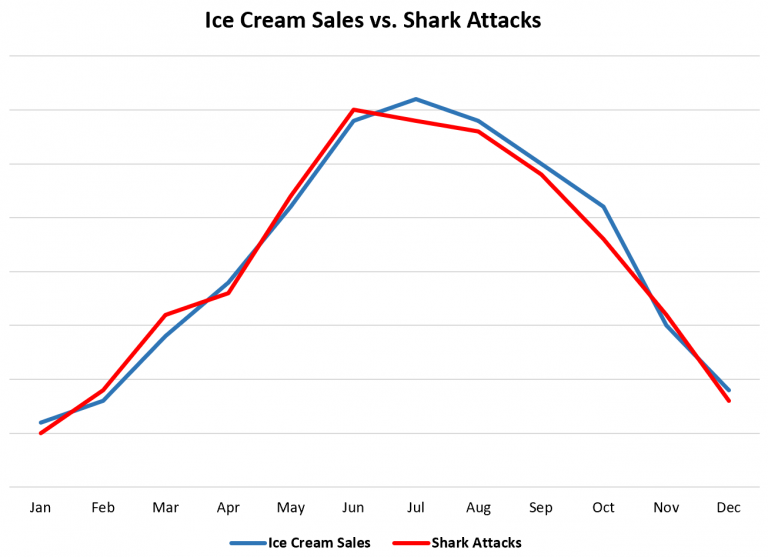

L’interpretazione dei risultati è uno degli ambiti più critici. È facile attribuire un significato causale a una semplice correlazione o dare per scontato che i dati rappresentino fedelmente la realtà che vuoi descrivere. In questi casi, bisogna imparare a mettere in discussione le assunzioni implicite con cui si leggono dati e risultati, perché molto spesso capita che siano influenzate da aspettative, obiettivi o convinzioni già presenti prima ancora di aprire il dataset. Un esempio classico è osservare che due variabili crescono insieme e concludere che una sia la causa dell’altra, senza considerare fattori esterni o variabili non osservate.

Errori matematici e statistici nell’analisi dei dati

Gli errori matematici e statistici, nella maggior parte dei casi, nascono da una comprensione parziale degli strumenti statistici utilizzati e dal modo in cui vengono applicati ai dati reali, indipendentemente dal fatto che nel progetto siano stati adottati i migliori linguaggi per l’analisi dei dati. Per esempio, è scorretto interpretare un risultato come definitivo solo perché “statisticamente significativo”, ma anche lavorare su campioni poco rappresentativi oppure ancora adattare troppo un modello ai dati storici. Si tratta di scelte che creano un’illusione di precisione, destinata a crollare quando l’analisi viene messa alla prova nella realtà operativa.

Errori di visualizzazione e comunicazione dei dati

Anche quando l’analisi è corretta, la visualizzazione può indurre in errore. Ricorda che un grafico non è mai una rappresentazione neutra: è già una forma di interpretazione. Una scala “troncata” nel punto sbagliato o una scelta grafica pensata più per colpire visivamente che per chiarire può enfatizzare differenze minime o nascondere informazioni rilevanti, orientando chi legge verso conclusioni sbagliate. In questi casi, una visualizzazione imprecisa finisce per influenzare le decisioni, spesso senza che chi legge se ne renda conto.

Come evitare gli sbagli nell’analisi dei dati per le aziende

Ma come si possono eludere questi rischi? Se manca un metodo condiviso, ogni analisi tenderà a riflettere le aspettative di chi la conduce più che la realtà descritta dai dati, e questa mancanza di consapevolezza rende difficile intercettare gli errori prima che arrivino al livello decisionale.

Un approccio efficace è quello di prevedere dei momenti di controllo distribuiti lungo tutte le fasi di lavoro. Naturalmente, per farlo occorre essere supportati dai giusti tool per la data analysis. Ad esempio, prima di passare all’analisi vera e propria, può essere utile verificare se il campione utilizzato rappresenta davvero il fenomeno che stai osservando o se alcune variabili rilevanti sono rimaste escluse. Lo stesso controllo andrebbe ripetuto dopo i primi risultati, chiedendosi se le conclusioni cambierebbero al variare di una singola ipotesi di partenza. Verificare la qualità dei dati in ingresso, esplicitare le ipotesi e rileggere i risultati alla luce del contesto operativo aiuta a rendere eventuali inesattezze più visibili. Solo così l’analisi può diventare un processo verificabile.

Data analysis in azienda: i consigli di Data Masters

Il valore che l’analisi dei dati assume all’interno dei processi aziendali, dipende dal livello di consapevolezza con cui viene utilizzata. Avendo un’influenza diretta su tutte le decisioni operative, compresi investimenti e strategie, richiede soft skills specifiche oltre, ovviamente, alle competenze tecniche. In sostanza, servono metodo e linguaggio condiviso.

La formazione su Data & AI di Data Masters lavora proprio su questo livello, perché fornisce alle aziende gli strumenti teorici e pratici per rendere i dati una vera e proprio bussola, in grado di guidare il business e sostenere scelte informate. Ne è un esempio il nostro Corso Dax Avanzato: 10 ore completamente dedicate alle Data Analysis Expressions, in cui si parlerà di Time Intelligence, ottimizzazione delle prestazioni, ma anche di KPI dinamici e funzioni complesse.

Se invece vuoi imparare sfruttare uno degli strumenti più utilizzati nelle aziende, ti consigliamo il Corso di analisi dei dati con Excel. Grazie alle formule avanzate e alla gestione di grandi dataset, le potenzialità di Excel per l’analisi dei dati sono straordinarie. Troverai una formazione di alto livello, perfetta per migliorare i processi decisionali interni e ottimizzare il lavoro con i dati.