La maggior parte di noi in questi anni ha sicuramente usato almeno una volta un chatbot llm, che fosse ChatGPT, Gemini o Claude. Tutto molto bello ma un chatbot che legge, decide e agisce è tutta un’altra storia. Tanto che in questi ultimi mesi si sente di più parlare di agenti AI, ossia quei tuttofare digitali che non si limitano a rispondere alle tue domande, ma effettivamente risolvono i problemi usando gli strumenti a loro disposizione.

Ma se si vuole andare oltre il semplice utilizzo ad alto livello di questi strumenti bisogna sporcarsi le mani col codice e con dei framework che ti permetteranno di costruire il tuo Agente AI personalizzato.

L’evoluzione degli agenti AI nel flusso informativo

Gli agenti AI non sono una novità assoluta, ma la loro accessibilità lo è. Tempo fa, costruire un sistema che potesse leggere il web, analizzare le informazioni e prendere decisioni autonome richiedeva un’architettura complessa e molto codice personalizzato. Oggi, con framework come Langchain, quella complessità è stata drasticamente ridotta.

Uno dei primi problemi con cui ci si scontra è il cosiddetto knowledge cut-off, ossia il fatto che un qualsiasi LLM, preso senza tool a supporto, non sa rispondere ad argomenti che vanno oltre il suo training, e questo è fondamentale quando parliamo di notizie, analisi di mercato o qualsiasi cosa richieda dati attuali.

Il limite del knowledge cut-off e la soluzione

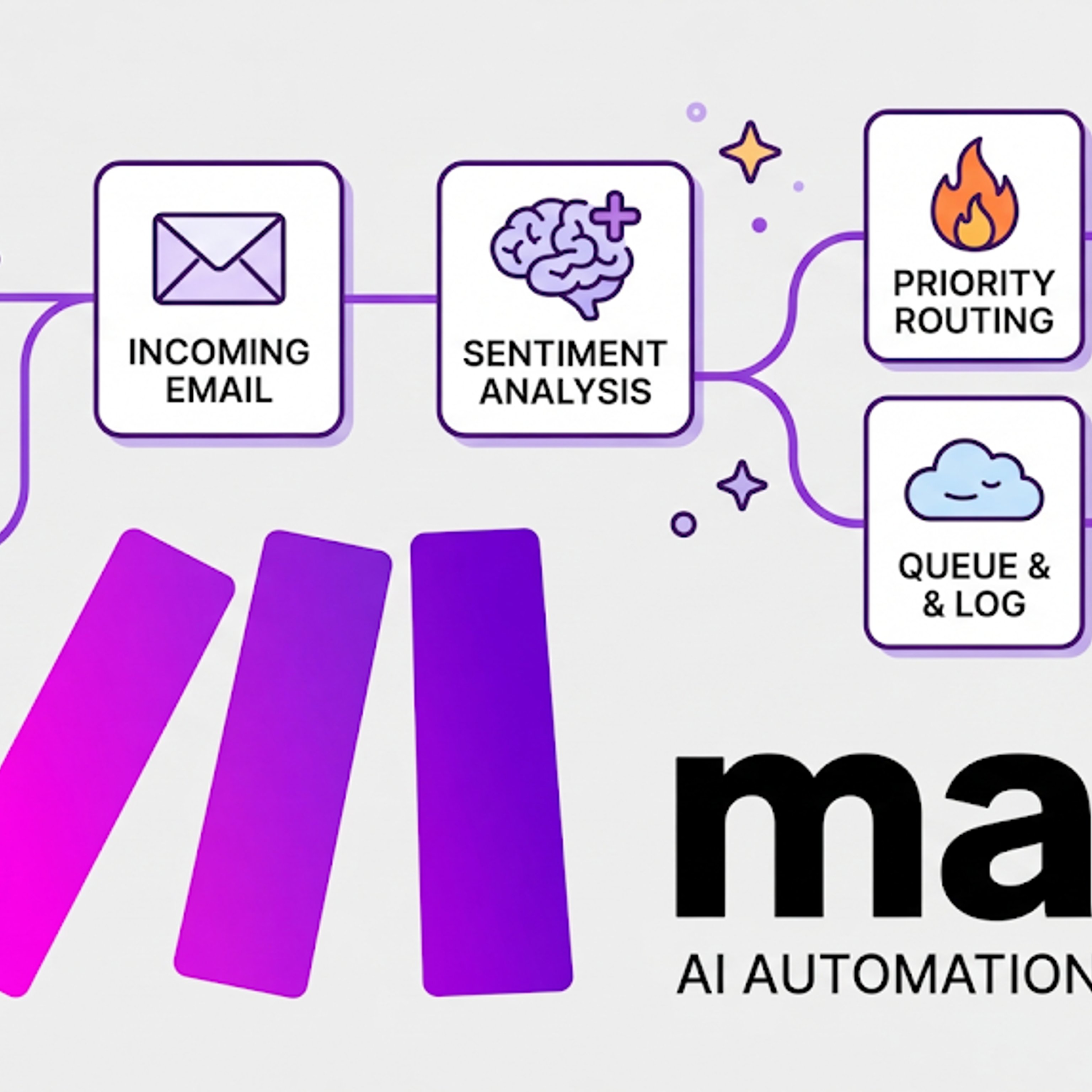

Il knowledge cutoff è il tallone d’Achille di ogni modello linguistico. Un LLM tradizionale non supera il cut‑off del modello, ma con Langchain si può risolvere usando dei tool esterni. Come? Integrando strumenti reali che possono cercare sul web, accedere a database attuali, leggere email, consultare API in tempo reale. L’agente non indovina più, consulta le fonti senza inventarsi nulla.

Questo ovviamente cambia completamente il gioco. Un agente AI con Langchain non è più limitato alla sua memoria di addestramento, ma diventa effettivamente autonomo, perché può decidere quale strumento usare per ottenere l’informazione di cui ha bisogno. Vuoi che cerchi le ultime notizie su un’azienda? O che calcoli il ROI di una campagna analizzando i dati del tuo database? Ha uno strumento per entrambi. Ecco il valore reale.

Architettura e Logica di un News Agent

Costruiamo un case study concreto: un agente che raccoglie notizie su argomenti specifici e le riassume per te. Sembra banale, ma è un ottimo modo per capire come funziona realmente l’orchestrazione.

Il paradigma ReAct (Reasoning and Acting)

ReAct sta per Reasoning and Acting e funziona come se fosse il “cervello” dell’agente. Funziona in un loop continuo dove il modello non solo pensa a cosa fare (reasoning) ma lo fa (acting), e successivamente valuta il risultato decidendo il passo successivo.

Immagina di chiedergli “Trovami le tre ultime notizie su Tesla e riassumile in italiano”. L’agente non dice semplicemente “Okay, fatto”. Invece pensa “Ho bisogno di cercare, quindi userò il mio strumento di ricerca web. Cercherò Tesla news. Otterrò risultati. Li leggerò. Li riassumerò”. Questo accade in modo iterativo, con il modello che riflette su ogni passo. La prima reazione che si ha quando funziona davvero è un misto tra stupore e magia.

Retrieval-Augmented Generation (RAG)

Creare un sistema RAG da zero è un discorso più ampio, ma cercheremo di semplificare. RAG significa che l’agente non inventa le risposte attraverso le famosi allucinazioni ma recupera le informazioni da fonti affidabili e poi le rielabora. Nel nostro caso del news agent, significa che l’agente cercherà delle notizie reali, le memorizzerà temporaneamente e le analizzerà basandosi solo su quelle.

Perché funziona? Perché il modello linguistico non sta più indovinando. Sta lavorando con dati concreti ed ha meno spazio per allucinare, per dirla in gergo tecnico.

Implementazione tecnica: costruire l’agente con Langchain passo dopo passo

Il toolkit è essenzialmente la cassetta degli attrezzi del tuo agente, che puoi sfruttare con Langchain definendo gli strumenti disponibili. Per un news agent, avrai qualcosa come DuckDuckGo Search, Google News API, o Serpapi per recuperare risultati attuali dal web.

In pratica il setup è diretto. Installi le librerie necessarie via pip, configuri le chiavi API del tuo servizio di ricerca, e poi crei un tool che l’agente può invocare. Questo all’inizio è sicuramente complicato e poco intuitivo, ma è fondamentale che ogni tool sia ben documentato e che l’agente capisca esattamente cosa fare.

Il punto è che gli strumenti devono essere specifici ma non troppo, infatti se dai all’agente 50 strumenti diversi, passerà metà del tempo a decidere quale usare.

Inizializzazione dell’agent executor in Python

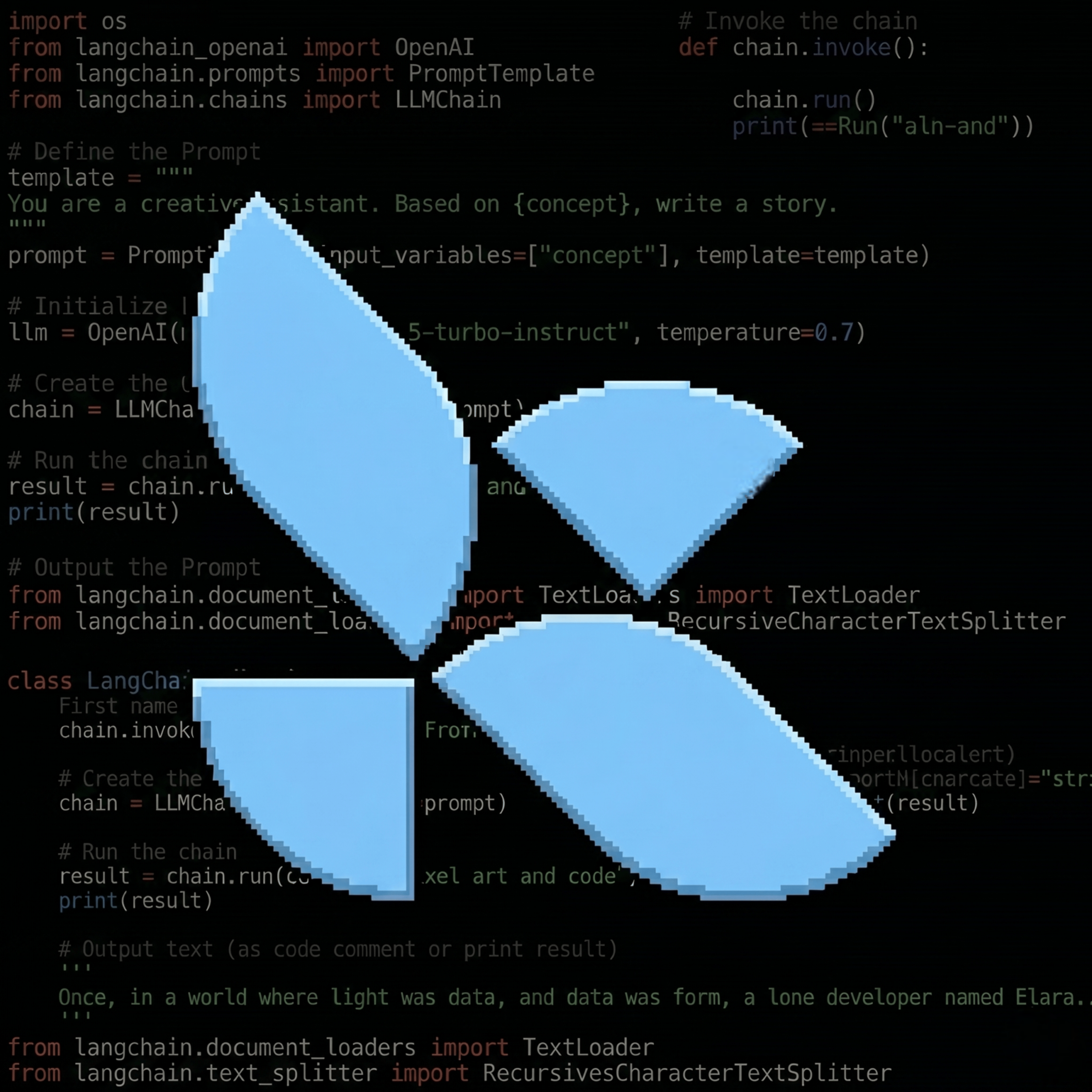

L’agent executor è il direttore d’orchestra. È il componente che coordina il flusso. Ecco uno sketch semplificato di come appare:

[Python] import os from dotenv import load_dotenv from langchain.agents import create_react_agent from langchain_community.tools import DuckDuckGoSearchResults from langchain_openai import ChatOpenAI from langchain_core.prompts import ChatPromptTemplate from langchain.agents import AgentExecutor load_dotenv() # carica OPENAI_API_KEY da .env llm = ChatOpenAI( model="gpt-4o-mini") # sostituisci con il modello che preferisci search_tool = DuckDuckGoSearchResults( num_results=8, # più risultati = riassunto più ricco output_format="list", # "list" | "json" | "text" ) search_tool.name = "duckduckgo_search" search_tool.description = ( "Strumento per cercare informazioni aggiornate su internet tramite DuckDuckGo. " "Usalo per trovare le notizie e gli eventi più recenti e in trend." ) tools = [search_tool] system_prompt = """Sei un assistente giornalistico esperto. Il tuo compito è cercare le notizie più in trend in questo momento, raccogliere informazioni da fonti diverse e produrre un riassunto chiaro, strutturato e informativo per l'utente. Hai accesso ai seguenti strumenti: {tools} Nomi degli strumenti disponibili: {tool_names} Usa il seguente formato: Thought: ragiona su cosa fare Action: il nome dello strumento da usare Action Input: la query da passare allo strumento Observation: il risultato dello strumento ... (ripeti Thought/Action/Action Input/Observation quante volte serve) Thought: ho abbastanza informazioni per rispondere Final Answer: [il riassunto completo delle notizie in trend] {input} {agent_scratchpad}""" prompt = ChatPromptTemplate.from_template(system_prompt) agent = create_react_agent( llm=llm, tools=tools, prompt=prompt, ) agent_executor = AgentExecutor( agent=agent, tools=tools, verbose=True, # mostra il ragionamento step-by-step max_iterations=8, # evita loop infiniti handle_parsing_errors=True, ) query = ( "Cerca le notizie più in trend di oggi su più argomenti diversi " "(politica, tecnologia, economia, sport, attualità internazionale) " "e producimi un riassunto completo e ben strutturato." ) result = agent_executor.invoke({"input": query})

Questo esempio di codice è semplificato, ma contiene gli elementi essenziali. Quando lo esegui, vedrai un output che mostra il pensiero step-by-step dell’agente. Che sia scientifico o no, è affascinante e didattico, perché puoi vedere esattamente cosa sta facendo l’agente che hai appena creato.

Ottimizzazione Professionale e Produzione

Adesso la parte che fa la differenza tra un giocattolo e un sistema serio.

Gestione dei workflow complessi con LangGraph

LangGraph è il passo successivo di Langchain quando hai bisogno di workflows più sofisticati. Invece di semplici decisioni lineari, puoi costruire grafi con stati, condizioni e loop complessi.

Pensa allo scenario di esempio di prima in cui un agente raccoglie delle notizie, le valida, le categorizza e le archivia. Non è un semplice A che porta a B ma una rete di scelte. Con LangGraph definisci i nodi (stati dell’agente) e gli edge (le transizioni tra stati), così l’agente può prendere percorsi diversi a seconda delle circostanze.

Validazione delle fonti e citazioni automatiche

Qui arriviamo ad un aspetto che la gente spesso sottovaluta: la responsabilità. Se il tuo agente produce informazioni, deve tracciare da dove vengono.

In pratica, mentre l’agente raccoglie notizie, memorizza anche le fonti. Questo non è difficile da implementare, ma è cruciale. Puoi quindi generare citazioni automatiche, link alle fonti originali, e credibilità complessiva al sistema. Un utente che vede “fonte: Reuters” accanto a una notizia è molto più fiducioso di uno che vede un’affermazione senza traccia.

Tanti progetti AI trascurano questo aspetto costruendo sistemi impressionanti che generano risultati vaghi e non tracciabili.

I consigli di Data Masters

Costruire un agente AI con Langchain è alla portata di chiunque abbia delle basi Python. Ci sono comunque dei suggerimenti che consigliamo a chiunque si stia approcciando a framework come Langchain.

Primo, non iniziare con un agente complesso. Parti da qualcosa di semplice, una singola funzione, una ricerca web, un calcolo, una query. Impara come funziona il loop ReAct con un singolo strumento e poi aggiungi complessità.

Secondo, testa il tuo agente pubblicamente e raccogli feedback. Un agente che funziona bene nel tuo ambiente di sviluppo potrebbe essere un disastro in produzione. Le edge case emergono quando le persone reali iniziano a usarlo.

Terzo, non affidarti ciecamente al modello linguistico validando sempre i suoi output. Se dice che ha trovato un numero, verifica che sia coerente. Se genera una citazione, controlla che la fonte esista davvero. L’agente è uno strumento, non un oracolo.

Infine, considera LangGraph non come upgrade opzionale, ma come necessità quando il tuo agente ha bisogno di decidere tra percorsi alternativi. La complessità della logica di controllo merita una struttura per gestirla.

Il futuro degli agenti AI passa attraverso Langchain, ma il successo passa attraverso il design, è per questo che abbiamo creato la AI Agentic Masterclass incentrata interamente su Langchain dove potrai imparare davvero come costruire un agente AI da zero in maniera professionale.